隨著人工智能技術(shù)的飛速發(fā)展,以ChatGPT為代表的大型語言模型正深刻改變著網(wǎng)絡(luò)空間的面貌。在網(wǎng)絡(luò)安全與信息安全軟件開發(fā)領(lǐng)域,這一變革尤為顯著,既帶來了前所未有的機(jī)遇,也引發(fā)了不容忽視的挑戰(zhàn)。

一、ChatGPT在網(wǎng)絡(luò)安全領(lǐng)域的積極賦能

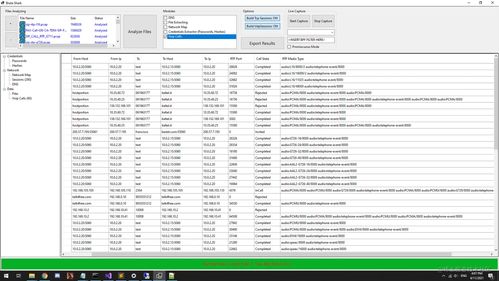

ChatGPT為網(wǎng)絡(luò)安全防御能力的提升注入了強(qiáng)勁動(dòng)力。在軟件開發(fā)環(huán)節(jié),它能夠輔助安全工程師進(jìn)行代碼審計(jì),通過自然語言指令快速識別潛在漏洞,如SQL注入、跨站腳本(XSS)等,并生成修復(fù)建議,顯著提高安全編碼的效率和準(zhǔn)確性。在安全運(yùn)營中心(SOC),ChatGPT可以解析海量日志和告警信息,自動(dòng)生成事件分析報(bào)告,幫助分析師快速理解攻擊模式,縮短響應(yīng)時(shí)間。它還能用于模擬網(wǎng)絡(luò)釣魚攻擊測試,生成更逼真的釣魚郵件內(nèi)容,以訓(xùn)練員工提升安全意識。

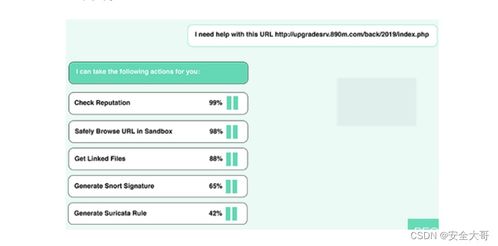

在信息安全軟件開發(fā)中,ChatGPT的集成正催生新一代智能安全工具。例如,基于其API開發(fā)的應(yīng)用程序可以實(shí)現(xiàn)智能化的威脅情報(bào)摘要、自動(dòng)化滲透測試腳本生成,或是創(chuàng)建交互式安全培訓(xùn)助手。這些工具不僅降低了專業(yè)門檻,也使安全防護(hù)更加主動(dòng)和個(gè)性化。

二、新型風(fēng)險(xiǎn)與安全挑戰(zhàn)

ChatGPT的強(qiáng)大能力也被惡意行為者所覬覦,給網(wǎng)絡(luò)安全帶來了新的威脅維度。攻擊者可以利用它高效生成惡意代碼、構(gòu)造復(fù)雜的社會(huì)工程學(xué)攻擊劇本,或批量生產(chǎn)用于混淆安全檢測的釣魚信息。這降低了網(wǎng)絡(luò)犯罪的技術(shù)門檻,使攻擊更加規(guī)模化、智能化。例如,自動(dòng)生成的釣魚郵件在語法和邏輯上幾乎與真實(shí)郵件無異,極大地增加了識別難度。

對于信息安全軟件開發(fā)而言,集成ChatGPT等AI模型本身也引入了新的攻擊面。模型可能遭受提示注入攻擊,被誘導(dǎo)輸出敏感信息或執(zhí)行有害指令;訓(xùn)練數(shù)據(jù)中的偏見或漏洞也可能被利用。因此,開發(fā)過程必須融入全新的“AI安全”考量,確保模型本身的安全性、可靠性和可控性。

三、邁向安全與智能的融合未來

面對這一雙刃劍,網(wǎng)絡(luò)安全行業(yè)必須積極應(yīng)對。一方面,應(yīng)大力發(fā)展以AI對抗AI的防御技術(shù),利用同類模型構(gòu)建更智能的檢測與響應(yīng)系統(tǒng)。例如,訓(xùn)練專門的模型來識別AI生成的惡意內(nèi)容。另一方面,在信息安全軟件開發(fā)中,必須將安全設(shè)計(jì)(Security by Design)原則貫穿始終,對AI組件進(jìn)行嚴(yán)格的安全測試與審計(jì),并建立相應(yīng)的倫理與使用規(guī)范。

政策與法規(guī)也需與時(shí)俱進(jìn)。各國正在探索對生成式AI的監(jiān)管框架,要求其開發(fā)與應(yīng)用,特別是在關(guān)鍵信息基礎(chǔ)設(shè)施領(lǐng)域,必須符合安全、透明和可問責(zé)的標(biāo)準(zhǔn)。行業(yè)內(nèi)部則應(yīng)加強(qiáng)協(xié)作,共享針對AI新型威脅的攻防知識。

結(jié)論

ChatGPT的興起標(biāo)志著網(wǎng)絡(luò)安全進(jìn)入了一個(gè)人機(jī)協(xié)同的新時(shí)代。它既不是純粹的解藥,也非單一的毒藥。對于網(wǎng)絡(luò)與信息安全軟件開發(fā)而言,關(guān)鍵在于如何駕馭這股力量——通過技術(shù)創(chuàng)新將AI轉(zhuǎn)化為堅(jiān)固的盾牌,同時(shí)通過前瞻性的管理和規(guī)范,防范其被鑄成鋒利的矛。唯有在機(jī)遇與風(fēng)險(xiǎn)之間取得平衡,我們才能構(gòu)建一個(gè)更智能、也更安全的數(shù)字未來。